There is a limit on number of words you can write in a single discourse post. I remember crossing it for one my my lesson notes and had to truncate it.

非常感谢这个说明

Thanks! Nice to know.

不客气,也谢谢你告之,这样才知道哪怕是多一点翻译,也可能会有帮助

帮助很大:fu:特别是在环境搭建方面,我是个跨领域的超级新手,虽然docs里给了一些说明,但是有些是需要科学上网才能用,有些注册方面有种种限制,有些费用需要认真计算才能知道到底要花多少钱,坑太多,而搭建本地环境也困难多多,能在翻译中有一些总结性的点睛式提示,对我这种新手来说,就是万里乌云中的一缕光啊,再次感谢!!!

Hi @PoonamV,

I want to make a TOC for your note in the format of the following approach (I have not figured out any other way). Do you mind?

Also I want to make a TOC of your note in Chinese, but the problem is that with the current approach the TOC won’t work outside of the note page (not even working in the reply), which means I have to add a few Chinese words after the English links in the TOC. It may seem strange to people don’t use Chinese.

I am still thinking about easy ways to work it around. Do you have any suggestions or solutions? Thanks

or maybe it is not such a bad idea to add Chinese, Japanese, Russian words in the TOC, so that before proper length translation is done, people still can get not only the whole picture but also some sense of each item is talking about. What do you think?

@jeremy

担心费用的话,建议用Google Cloud Platform, 一开始就有300刀的免费credit。就是可能因为科学上网的问题,坑会有点多。

被你这么一提醒,我觉得我们真的是应该开一个Post集中注意力解决一下墙内用户可能碰到的问题。

Kaggle仍旧不够用吗?

对的,Kaggle其实不怎么够用,因为有些数据集是V100都得训练几个小时的。

嗯,理解,不知道阿里云是否愿意在国内做AWS为fastai做的事?

还有,这里V100是什么意思呢?

哈哈,我们尝试着把中文Community搞起来,他们肯定是愿意的。靠我们大家努力啦。

Nvidia Tesla V100.

阿里云并不比GCP便宜, 上个月瞄过一眼, P100美西的bidding pricing差不多2刀一个小时(exchange rate roughly*6, around 12rmb / hour with bidding)

安装fastai和pytorch并不是什么特别困难的事情… 目前看来,

- GCP是最便宜的, 因为300刀的credit. (另外现在GCP是需要quota的, 英文版GCP的tutorial并没有涉及到quota application的问题)

- Paperspace是最容易的, 基本不需要setup

- Kaggle是最简单的地方pre-processing data, 基本上我所有的pre-processing, 理解fastai code block都在kaggle上进行的, 一旦合适了我会回到GCP上进行trainning. (Kaggle 可以使用no datasource, 然后untar(…) fastai 所有的library都可以下载, 另外模型的时候(create_cnn(),leaner())记得指定一下路径, model_dir = ‘/kaggle/model’ 基本上可以跳过很多坑)

- Kaggle 的问题在于GPU, 计算能力并不是特别好. Hampack Whale的base model, 用resnet34 大概需要40分钟, resnet50大概要1.5小时左右. 而在GCP上按照tutorial推荐的配置, 基本在20分钟以内.

谢谢分享!能否解释一下,什么是quota,以及为什么需要解决quota application相关问题?

根据fast.ai的指南,crestle似乎是最容易的,不需要任何安装。但我没有实际使用对比过。你有两者使用对比经验可以具体说明一下吗?谢谢!

算力方面,Kaggle, Colab与GCP相比,Colab的算力大概是怎样的呢?谢谢!

我设置环境已经有2-3个月了, 我不确定具体流程是否有改变. 另外Colab我没有使用过.

- 关于quota的问题, 无论是paperspace还是GCP, 都涉及到GPU的问题. Paperspace default我记得是只有P4000,如果你想要使用P5000,你需要写信给paperspace, 当通过后,你才能创建一个P5000的instance

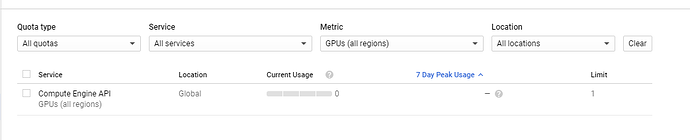

GCP的话我记得free tier的GPU上限全部是0, 所以如果你run课程的脚本, 会有一个Quota 0.0的报错, 你需要upgrade你的帐号(300credit 保留), 然后写信给google, ask for quota increase.

Paperspace是30分钟通过我的, GCP好像等了半天

By default, 新帐号的limit应该是0

-

至于GPU方面, 那就得看看浮点数的运算能力. 这个有很多文章评论, 我基本上还是按照课程推荐的设置来进行的, kaggle用的好像是Tesla K80? 而GCP fastai 推荐的是P4

-

另外, 如果不想付费. 因为我不是墙内的用户, 所以我也不太清楚kaggle能不能直接登录

可以在自己的电脑上跑简单的model, 当然, segmentation的问题肯定是时间很长

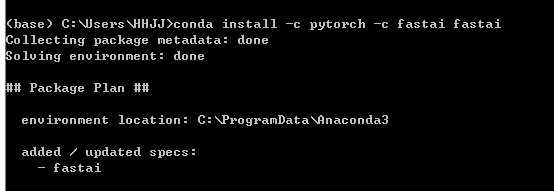

具体设置可以使用conda, 先安装

-

Anaconda3

然后运行Anaconda prompt (windows) -

之后conda install -c pytorch -c fastai fastai

当然, 我个人是很不推荐用这个方法. 因为GPU memory的问题, 建议有能力的话还是用kaggle或者GCP. 另外就是AMD的GPU不支持cuda, 所以如果不是nvdia的GPU基本上就只能用CPU来跑了

特别说明一下, 我自己的电脑因为没有nvdia gpu,所以只能处理一些processing的问题

比如测试一下datablock api, custom item list, hook 以及一些pytorch的功能. 所以我不太清楚这么安装cuda能否工作

好的,谢谢你的使用分享!

Hi @PoonamV , could you show me how to free the word limit in a single post? thanks!

I could not find anything useful online to deal with it.

完全同意!其实假如GCP上面用Preemptible Instance的话,GPU的价格简直便宜到离谱。下面是最新的价目表:

| GPU | Standard (Prices vary by location) | Previous Preemptible (All Locations) | New Preemptible (All Locations) |

|---|---|---|---|

| V100 | $2.48 | $1.24 | $0.74 |

| P100 | $1.46 | $0.73 | $0.43 |

| K80 | $0.45 | $0.22 | $0.135 |

基础instance的价格相对于GPU基本可以忽略不计。我们选的类型是n1-highmem-8,$0.12/h ,已经是52G内存,8 vCPU了。

所以GCP上面V100也就¥5.78/小时,P100更是只有¥3.69/小时。这年代小学生三线城市网吧上网都不止这个价钱了吧

下面是我查到的阿里云在张家口,相对来说应该已经是较便宜的一个节点的价目表:

毫不客气地说,GCP上面V100都比阿里云的P4便宜;而P100的算力差不多是P4的两倍,而V100差不多是P100的两倍。V100上假如能正确使用mixed-precision training的话,还可以提速近一倍,所以最后达到P4训练速度的6-8倍是很轻松的。更别提连外网的速度GCP上面要更快,下载数据集也更迅速。在我看来,没有任何理由选择阿里云。